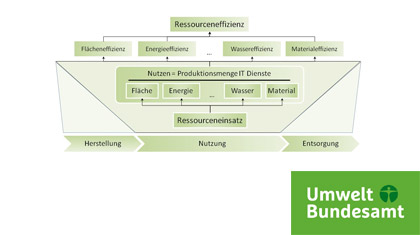

Das Umweltbundesamt hat future thinking ausgesucht, um zwei Blaue Engel für energie- und ressourceneffizienten RZ-Betrieb zu vergeben. Für die Optimierung ihrer Rechenzentren und der Einhaltung der besonders hohen Vorgaben wurden das Bundesamt für Seeschifffahrt und Hydrographie (BSH) sowie die CEWE Stiftung ausgezeichnet. Die Urkunden übergab Marina Köhn, Umweltbundesamt (UBA), Berlin

Natur- und Klimaschutz zählen zu den größten globalen Herausforderungen unserer Zeit. Auch der Einfluss der IT wird bei anhaltender Durchdringung jedweder Geschäfts- und Lebensbereiche kontrovers diskutiert.

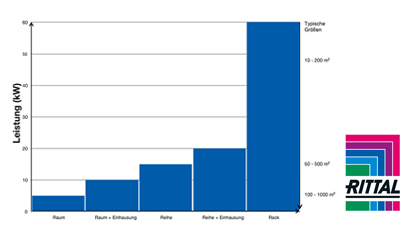

Bei der Modernisierung eines Rechenzentrums können Unternehmen durch die Wahl der richtigen Klimatechnik ihre laufenden Betriebskosten senken. Der Beitrag zeigt, wie IT-Verantwortliche die Kosten für Anschaffung und Betrieb moderner Klimakonzepte für ihr Rechenzentrum kalkulieren.

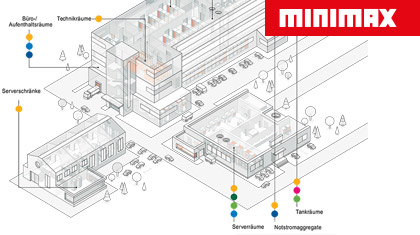

In der Wertschöpfungskette der meisten Unternehmen haben die Informations- und Kommunikationstechnologien Schlüsselfunktionen. Schon kleinste Unterbrechungen oder Verfügbarkeitseinschränkungen können für Unternehmen existenzbedrohende Folgen haben.

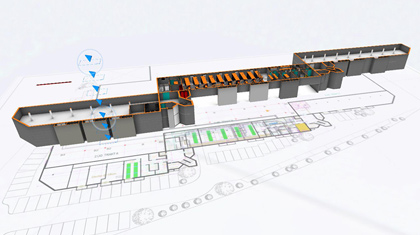

Die Welt der Planer spricht über BIM oder BIM basierte Planung: Ob Krankenhaus, Bürogebäude, Einfamilienhaus oder Wolkenkratzer – die Planung auf der Basis von BIM bietet für jede Gebäudeart entscheidende Mehrwerte. Doch wofür steht BIM, was genau versteckt sich hinter dieser zukunftsweisenden Methode und welche konkreten Vorteile bietet sie?

Mit der europäischen Rechenzentrumsnorm EN 50600 soll der Bau und Betrieb von Rechenzentren erstmals ganzheitlich geregelt werden. Eine echte Mammutaufgabe, denn jedes Rechenzentrum hat seine individuellen Eigenheiten, weswegen sich ein für alle Datacenter gleichermaßen geltender Leitfaden nur schwer entwickeln lässt. EN 50600 löst dieses Problem, indem sie Anforderungen und Empfehlungen definiert, die alle Vertreter der Branche gleichermaßen betreffen. Wer in der Rechenzentrumsbranche tätig ist, sollte die Norm daher gut kennen.

Ob in der Automobil-, Chemie-, Bau- und Lebensmittelindustrie oder sogar in der IT-Branche: Die F-Gase-Verordnung Nr.517/2014 der Europäischen Union ist derzeit in aller Munde und wird kontrovers diskutiert.Hier hat die sonst doch sehr behäbige EU-Bürokratie einmal knallharte Fakten geschaffen und zwingt alle Nutzer, Betreiber und Verarbeiter zum kurz- oder mittelfristigen Handeln. Alternativen sind rar und vor allem die RZ-Branche steht vor einer gewaltigen Herausforderung – doch wie bewältigt man sie am besten?